Un secolo di evoluzione nell'hardware delle telecamere di sicurezza e nell'ottica per immagini

La preistoria meccanica: dalla registrazione cinetica ai prototipi a circuito chiuso

Il percorso tecnico delle telecamere di sicurezza non è stato un successo immediato, ma un’evoluzione interdisciplinare durata due secoli. Le sue radici possono essere fatte risalire alla fine del XIX secolo con i primi tentativi di catturare immagini dinamiche continue. Nel 1870, l'inventore inglese Wordsworth Donisthorpe brevettò il "kinesigrafo", una macchina fotografica in movimento progettata per scattare una serie di foto a intervalli prestabiliti per catturare il movimento.1Nel 1889, Donisthorpe e Louis Le Prince perfezionarono ulteriormente le cineprese e la tecnologia di proiezione; Le Prince sviluppò persino una fotocamera con 16 obiettivi che, sebbene all'epoca fosse più uno strumento sperimentale, gettò le basi fisiche per il monitoraggio continuo in spazi specifici.1

Il primo vero sistema di televisione a circuito chiuso (CCTV) è nato per esigenze militari durante la seconda guerra mondiale. Nel 1942, l'ingegnere tedesco Walter Bruch fu incaricato di progettare e supervisionare un sistema per monitorare i lanci di razzi A4 (V-2) da un bunker sicuro.1Il nucleo di questo sistema era la sua natura "a circuito chiuso", il che significa che i segnali video venivano trasmessi solo a monitor preimpostati e non pubblici. La tecnologia di imaging dell'epoca si basava interamente su ingombranti tubi a vuoto e complessi circuiti analogici, senza mezzi di registrazione. Il personale di sicurezza doveva guardare i monitor in tempo reale, poiché le informazioni andavano perse per sempre una volta scomparsa l'immagine.2

Nel 1949 l'azienda americana Vericon lanciò il primo sistema TVCC commerciale, segnando il passaggio dal settore militare a quello commerciale e civile.3Questi primi sistemi commerciali utilizzavano principalmente telecamere fisse in bianco e nero collegate tramite cavi coassiali. A causa dell'elevato calore, dell'elevato consumo energetico e dei requisiti di 110 V CA dei tubi a vuoto, l'installazione era strettamente limitata e spesso richiedeva che la telecamera si trovasse entro 6 piedi da una presa di corrente.5Inoltre, le prestazioni ottiche erano estremamente limitate, con risoluzioni intorno alle sole 240 linee.

Il picco e i pericoli dei tubi a vuoto: Vidicons contro Plumbicons

Prima che la tecnologia di imaging dei semiconduttori maturasse, i tubi a vuoto (Pick-up Tubes) erano l’unico nucleo delle telecamere di sicurezza. Questi dispositivi erano essenzialmente tubi a raggi catodici (CRT) che funzionavano al contrario. Negli anni '50, Weimer, Forgue e Goodrich della RCA svilupparono il Vidicon, un tubo per fotocamera di tipo storage che utilizzava un semiconduttore fotosensibile (inizialmente trisolfuro di antimonio) come bersaglio.7

Meccanismo fisico e limitazioni materiali

Il principio di funzionamento di un tubo fotografico prevede la messa a fuoco di una scena su un bersaglio fotosensibile tramite una lente ottica, che viene quindi scansionata da un fascio di elettroni a bassa velocità proveniente da un cannone elettronico. Quando la luce colpisce il bersaglio, la conduttività locale cambia, provocando la fluttuazione della corrente del fascio di elettroni e convertendo la luce in segnali video.8Il Vidicon ha ridotto significativamente le dimensioni e i costi della telecamera, rendendola lo standard per la sorveglianza non trasmessa.7

Tuttavia, il Vidicon soffriva di un fatale difetto di "burn-out". Se puntato troppo a lungo verso il sole, superfici altamente riflettenti o punti luminosi intensi, il bersaglio fotosensibile subirebbe danni fisici permanenti, creando "punti ciechi".8Inoltre, i Vidicon erano suscettibili all '"effetto microfonico", in cui forti rumori o esplosioni causavano vibrazioni fisiche nel target a pellicola sottile, producendo barre orizzontali sullo schermo.8

Per superare la bassa sensibilità e il grave "trascinamento" (code di cometa) del Vidicon, Philips ha introdotto il Plumbicon negli anni '60. Utilizzando l'ossido di piombo come bersaglio, il Plumbicon offriva elevati rapporti segnale-rumore e un ritardo dell'immagine estremamente basso.7Nonostante il successo nelle trasmissioni, il suo costo elevato ne limitava l'uso in ambito di sicurezza ad applicazioni di fascia alta. Fu solo alla fine degli anni '70, con l'evoluzione della tecnologia in condizioni di scarsa illuminazione come Tivicon (tubo con diodo al silicio) e Newvicon (prodotto da Panasonic), che i tubi a vuoto soddisfacevano le esigenze fondamentali del monitoraggio notturno.10

La tabella seguente riassume l'evoluzione delle prime telecamere di sicurezza a tubo a vuoto:

| Fase Tecnica | Sensore centrale | Anno rappresentativo | Linee televisive | Caratteristiche principali | Limitazioni |

| Iniziazione | I primi tubi fotoelettrici | 1942 | 100-200 | Uso militare, osservazione in tempo reale |

Estremamente ingombrante, nessuna registrazione4 |

| Commercializzazione | Vidicon | Anni '50 | 240 | Struttura semplice, riduzione dei costi |

Facile da bruciare, bassa sensibilità7 |

| Aumento delle prestazioni | Plumbicon | Anni '60 | 400+ | SNR elevato, ritardo basso |

Molto costoso8 |

| Picco analogico | Newvicon/Saticon | Anni '70 | 480-700 | Funzionalità anticipata in condizioni di scarsa illuminazione |

Ancora grande, dipendente dall'alimentazione CA10 |

Il momento Nobel del silicio: la nascita e il regno del CCD

Il 1969 fu una pietra miliare nella storia dell’imaging moderno. Willard Boyle e George Smith dei Bell Labs inventarono il dispositivo ad accoppiamento di carica (CCD), un risultato che in seguito valse loro il Premio Nobel per la fisica.13Il CCD ha rivoluzionato l'hardware delle telecamere di sicurezza, sostituendo i fragili tubi a vuoto con chip di silicio a stato solido.13

L'arte dell'accoppiamento di carica: l'analogia del secchio d'acqua

Il principio di funzionamento di un CCD può essere paragonato a "una serie di secchi che raccolgono l'acqua piovana". Ogni pixel (atomo di silicio) sul sensore agisce come un secchio che raccoglie i fotoni (gocce di pioggia). L'effetto fotoelettrico converte i fotoni in fotoelettroni, che vengono immagazzinati in pozzi di potenziale. Durante la fase di lettura, queste cariche vengono spostate riga per riga come una staffetta verso un amplificatore di lettura e convertite in tensione.13Il vantaggio del CCD risiede nell'elevata uniformità dell'immagine e nel basso rumore di pattern, poiché tutti i pixel solitamente condividono da uno a quattro amplificatori di lettura, garantendo la coerenza.13

Fairchild Semiconductor ha lanciato il primo CCD commerciale al mondo, l'MV-100, nel 1973, con una risoluzione di soli 100x100 pixel.14Sebbene inizialmente destinata all'uso industriale e militare, ha aperto la strada alle telecamere di sicurezza "tascabili".16Sony ha investito l'incredibile cifra di 20 miliardi di yen in ricerca e sviluppo nel corso degli anni '70, commercializzando infine la fotocamera CCD a colori XC-1 nel 1980.18Questa mossa, considerata all’epoca una scommessa suicida, fece sì che Sony diventasse per decenni la forza dominante nel mercato globale dei sensori di immagine.19

L'età d'oro del monitoraggio analogico e dell'evoluzione dei PCB

Durante il regno del CCD negli anni '80 e '90, anche l'elettronica interna della fotocamera ha subito cambiamenti radicali. La tecnologia dei circuiti stampati (PCB) è passata dalla carta fenolica ai substrati in fibra di vetro, migliorando notevolmente la stabilità termica e l'integrità del segnale.6Negli anni '70, i PCB supportavano solo il cablaggio su un solo lato; negli anni '80, i PCB a doppia faccia consentirono di integrare più componenti di elaborazione del segnale (come i primi processori video) in piccoli alloggiamenti per fotocamere.6Durante questo periodo, i sistemi di sicurezza utilizzavano cavi coassiali per trasmettere segnali analogici, con una risoluzione che raggiungeva il limite fisico della tecnologia analogica: circa 700 linee TV (TVL).5

CMOS APS e la rivoluzione digitale: dalla "cattura" al "calcolo"

Sebbene il CCD sia stato per molto tempo all'avanguardia nella qualità delle immagini, la sua complessa produzione, l'elevato consumo energetico e l'incapacità di integrare circuiti logici hanno limitato ulteriormente l'intelligenza della fotocamera. A metà degli anni '90, la tecnologia del sensore a pixel attivi a semiconduttore a ossido di metallo complementare (CMOS APS) iniziò a maturare.13

La battaglia architettonica: CMOS contro CCD

A differenza della "lettura seriale" del CCD, ogni pixel in un sensore CMOS ha il proprio amplificatore e circuito di lettura. Questa architettura offre molteplici vantaggi tecnici:

-

Alta integrazione:Processori di segnali di immagine (ISP), convertitori analogico-digitali (ADC) e circuiti di controllo della temporizzazione possono essere integrati sullo stesso die di silicio, formando un System-on-Chip (SoC).21

-

Altissima velocità:Con migliaia di canali di lettura, la velocità del CMOS può essere 100 volte più veloce del CCD, consentendo il monitoraggio con frame rate elevato (60 fps o superiore) e la riproduzione al rallentatore.13

-

Controllo della potenza:Il CMOS consuma una quantità significativa di energia solo durante la commutazione dei pixel, riducendo drasticamente il calore, un fattore critico per le operazioni di sicurezza 24 ore su 24, 7 giorni su 7.13

Nel 2007, il CMOS ha raggiunto la parità di mercato con il CCD e nel 2019, con la popolarità della tecnologia Back-Illuminated (BSI), le prestazioni del CMOS hanno superato il CCD.13BSI riordina gli strati del sensore in modo che la luce colpisca il fotodiodo prima dello strato del circuito, aumentando drasticamente l'efficienza quantica (QE) e ponendo le basi per la sorveglianza "Starlight".14

La tabella seguente mette a confronto CCD e CMOS nelle moderne applicazioni di sicurezza:

| Parametro | Sensore CCD | Sensore CMOS (APS) | Impatto sulle tendenze |

| Velocità di lettura | 1 - 40 MP | 100 - 400+ MPS |

Abilitato lo streaming video HD13 |

| Leggi Rumore | 5 - 10 elettroni | 1 - 3 elettroni |

Chiarezza migliorata in condizioni di scarsa illuminazione13 |

| Gamma dinamica | Alta (full frame) | Estremamente alto (HDR) |

Progressi WDR facilitati15 |

| Costo | Alto (linee specializzate) | Basso (CMOS standard) |

Ha favorito la democratizzazione delle fotocamere13 |

| Integrazione | Basso (chip esterni) | Alta (SoC a chip singolo) |

Ha portato alle fotocamere Edge AI22 |

Evoluzione delle lenti ottiche: dal vetro fisso ai sistemi intelligenti

Se il sensore è la "retina" di una macchina fotografica, l'obiettivo è la sua "lente cristallina". Nella sicurezza, le lenti devono mantenere il potere risolutivo in ambienti altamente variabili.

Superare l'aberrazione: l'ascesa degli elementi asferici

Le lenti di monitoraggio iniziali erano per lo più sferiche. La natura fisica delle lenti sferiche fa sì che i raggi luminosi ai bordi e al centro non convergano nello stesso punto, causando aberrazione sferica e sfocatura dei bordi.26Per risolvere questo problema, le lenti di sicurezza hanno iniziato ad adottare in massa elementi asferici. Sebbene la teoria sia stata proposta da Cartesio nel 1637, fu solo negli anni '80 che lo stampaggio di precisione del vetro rese possibile la produzione di massa, consentendo aperture più grandi (F/1.4 o F/1.0) senza sacrificare la chiarezza.27

Zoom e correzione automatica del back-focus

Negli anni '70, la necessità di angoli di visione flessibili portò alla nascita degli obiettivi zoom. Tuttavia, gli obiettivi zoom tradizionali spesso perdono la messa a fuoco durante i cambiamenti della lunghezza focale. Per garantire la chiarezza, l'industria ha sviluppato meccanismi di "regolazione del back-focus" per mantenere la messa a fuoco bloccata sul piano del sensore dalle estremità grandangolari a quelle del teleobiettivo.29I moderni obiettivi zoom motorizzati incorporano motori passo-passo di precisione per regolare automaticamente il campo visivo in base all'attivazione dell'allarme.26

P-iris: risolvere il dilemma della diffrazione nell'era dell'HD

Quando la risoluzione del sensore è passata da 0,3 MP a 8 MP (4K), sono emersi i difetti dei tradizionali obiettivi con diaframma automatico. Gli iris DC convenzionali regolano solo la dimensione di apertura in base alla luminosità. in ambienti luminosi, l'iride si chiude così strettamente da provocare una grave diffrazione, sfocando l'immagine, un fenomeno noto come "limite ottico".30

Per contrastare questo problema, Axis Communications ha introdotto la tecnologia P-iris (Precise Iris). P-iris non si affida esclusivamente ai sensori di luce; utilizza un software per comunicare con un motore passo-passo nell'obiettivo.

-

Selezione dell'apertura ottimale:Il software identifica il "punto debole" dell'obiettivo (di solito un F-stop di fascia media) e lo mantiene il più possibile.30

-

Guadagno e collegamento dell'esposizione:Quando la luce è troppo forte, il sistema dà priorità a un'esposizione più breve o alla riduzione del guadagno elettronico piuttosto che chiudere eccessivamente il diaframma, evitando così la diffrazione.30

-

Profondità di campo massimizzata:Per scene come corridoi lunghi, P-iris ottimizza la profondità di campo per garantire che sia il primo piano che lo sfondo rimangano chiari.33

Progresso dell'ISP: l'ascesa del nervo ottico digitale

Per essere visualizzabili, i dati grezzi provenienti dal sensore devono essere elaborati da un processore di segnali di immagine (ISP). L'evoluzione dell'ISP è ciò che ha trasformato il monitoraggio della sicurezza da "vedere" a "vedere in modo chiaro e accurato".

Percorsi tecnici verso l'ampia gamma dinamica (WDR)

Nelle scene retroilluminate (come la finestra di una banca), la differenza tra aree chiare e scure può superare 100.000x. Gli ISP gestiscono questo problema attraverso tre metodi principali:

-

WDR digitale (DWDR):Un algoritmo software che regola le curve gamma per schiarire le aree scure. Basso costo ma alto rumore.35

-

Vero WDR (fusione multiesposizione):La soluzione mainstream di fascia alta. L'ISP ordina al sensore di scattare due fotogrammi in rapida successione: una breve esposizione (alte luci) e una lunga esposizione (ombre). La registrazione a livello di pixel li fonde quindi perfettamente.36

-

WDR forense:Una versione ottimizzata per ridurre gli artefatti da movimento, garantendo che gli oggetti in movimento non presentino "ghosting", che è fondamentale per il riconoscimento delle targhe.25

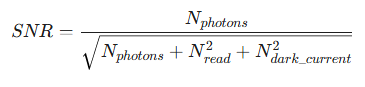

Il rapporto segnale-rumore (SNR) negli algoritmi ISP può essere descritto da:

Innovazioni estreme in condizioni di scarsa illuminazione: Starlight e Blacklight

L’ultima frontiera della sicurezza è l’oscurità. La tradizionale visione notturna IR comporta la perdita di colore, rendendo impossibile identificare i colori degli indumenti o dei veicoli.40

I tre pilastri hardware delle fotocamere "Starlight".

Il successo di Starlight si basa sul superamento dei limiti fisici:

-

Sensori di grande formato:Utilizzando sensori da 1/1,8 pollici o addirittura 1/1,2 pollici. Ciò aumenta l'area di ricezione della luce per pixel, catturando più fotoni.39

-

Ottiche ad apertura ultra ampia:Dotato di obiettivi F/1.0 o F/0.95, che forniscono 4 volte la luce assorbita dagli obiettivi F/2.0 standard.26

-

Algoritmi dell'otturatore lento:Stacking di frame nell'ISP per aumentare il tempo di integrazione. Anche se questo introduce un po' di motion blur, produce immagini a colori simili a quelle del giorno in ambienti da 0,001 Lux.24

Fusione a doppio sensore Blacklight (DarkFighter X).

Quando la luce scende al di sotto di 0,0001 Lux, il guadagno da solo non è sufficiente. Produttori come Hikvision (DarkFighter X) e Keda hanno lanciato la tecnologia Blacklight, che imita i bastoncelli e i coni dell'occhio umano:

-

Divisione ottica:Un prisma specializzato divide la luce in percorsi visibili e infrarossi.44

-

Doppi sensori:Un sensore cattura l'IR (luminanza e dettaglio), mentre l'altro cattura la luce visibile debole (colore).

-

Fusione a livello di pixel:L'ISP adatta i due percorsi in tempo reale, producendo video luminosi, a colori e con basso rumore. Ciò richiede una precisione di calibrazione sub-pixel.44

Sinergia multi-obiettivo e imaging computazionale: una nuova era

Il monitoraggio moderno sta andando oltre una singola prospettiva verso piattaforme di fusione multisensore.

Giunzione panoramica (PanoVu) e collegamento a doppia lente (TandemVu)

Per coprire aree estese come piazze o aeroporti, la serie PanoVu di Hikvision integra da 4 a 8 sensori. Gli algoritmi dell'ISP eseguono il "seamless stitching", che include:

-

Coerenza dell'esposizione:Garantire che la luminosità sia uniforme su tutti i sensori.45

-

Registrazione dei pixel:Eliminazione dei punti ciechi e delle immagini fantasma sulle cuciture.45

-

Monitoraggio multidirezionale:Un indirizzo IP e un cavo possono gestire una visione a 360 gradi, riducendo i costi di sistema.47

Fotografia computazionale e illuminazione intelligente

L’imaging computazionale sta offuscando il confine tra hardware e software.

-

Luce ibrida intelligente:Telecamere come Smart Hybrid Light di Hikvision utilizzano l'intelligenza artificiale per passare dalla modalità IR discreta alla modalità colore a luce bianca quando viene rilevata una persona o un veicolo.41

-

Fusione multispettrale:Fusione termica (LWIR) e luce visibile. Il termico rileva il calore (obiettivi nascosti), mentre il visibile li identifica, migliorando notevolmente la precisione della protezione perimetrale.51

Visione 2030: il futuro dirompente dell’hardware di sicurezza

Guardando al 2030, la forma delle telecamere di sicurezza subirà un altro cambiamento qualitativo.

Sensori di imaging senza lenti e quantistici

La ricerca suggerisce che le "fotocamere senza obiettivi" basate sull'ottica computazionale stanno maturando. Utilizzando codificatori ottici sottili invece di lenti in vetro, le fotocamere possono diventare sottili come adesivi.20Inoltre, i diodi a valanga a fotone singolo (SPAD) consentiranno l'imaging in condizioni di luce zero (conteggio dei fotoni).20

Emozione e riconoscimento dell'intento

Entro il 2030, le telecamere non saranno solo strumenti visivi:

-

Monitoraggio biometrico:Utilizzo di vibrometri laser Doppler a lungo raggio per catturare battiti cardiaci e respirazione.55

-

Analisi delle emozioni:Le reti neurali profonde analizzeranno le microespressioni e il linguaggio del corpo per eseguire la “previsione delle intenzioni” prima che si verifichi un crimine.55

-

Autonomia dei bordi:Con il 5G/6G e i chip AI a basso consumo, le telecamere fungeranno da “guardie digitali”, eseguendo tutte le analisi localmente e caricando i dati crittografati tramite protocolli quantistici.3

Conclusione: un secolo riassunto in luci e ombre

L'evoluzione delle telecamere di sicurezza è la storia dell'infinita ricerca della "visibilità" da parte dell'umanità. Da una macchina bunker del 1942 al terminale odierno basato sull'intelligenza artificiale con fusione a livello di pixel e visione notturna a colori, ogni passo è stato un trionfo sui limiti fisici. Le lenti sono passate da sferiche ad asferiche e le iridi da manuali a P-iris; i sensori sono passati dai tubi ingombranti al CMOS BSI e al rilevamento quantistico; La tecnologia PCB è passata da semplici connessioni a piattaforme SoC ad alte prestazioni.

Il futuro della sicurezza non sarà un insieme di freddo hardware ma una fusione di fisica, semiconduttori e intelligenza artificiale. Pur tutelando la società, la vera sfida per il prossimo decennio sarà trovare l’equilibrio tra progresso tecnologico ed etica della privacy.